GoogleのオープンLLM「Gemma 4」は、ローカル環境で動かせる現実的な選択肢として注目されています。今回はMacでLLMを手軽に扱えるOllamaを使い、M2 Mac mini(メモリ16GB)で実際に動作を検証しました。

ローカルLLMとは、ChatGPTのようなAIをクラウドではなく、自分のPC上で直接動かす仕組みのことです。インターネット接続なしでも動作し、データを外部に送らずに使えるのが特徴です。

結論から言うと、16GBでも動作は可能。ただし「快適に使うには厳しい」というのが正直なところです。

どこまで使えるのか、どこで限界を感じるのか。そしてAI用途を見据えてMacを選ぶ際に後悔しやすいポイントも整理します。

1. OllamaでGemma 4を動かす手順(最短ルート)

MacでローカルLLMを動かすなら、現時点ではOllamaが最も手軽です。セットアップは数分で終わります。

# Ollamaのインストール

brew install ollama

# サービス起動

brew services start ollama

# Gemma 4の起動(初回は自動DL)

ollama run gemma4:e4bこれだけでターミナル上でAIとの対話が始まります。API経由でn8nや自動化ツールと連携できるのも大きなメリットです。

2. M2 Mac mini(16GB)の実用性はどこまでか

検証環境はDockerとn8nを常時稼働させているサーバー用途のMacです。

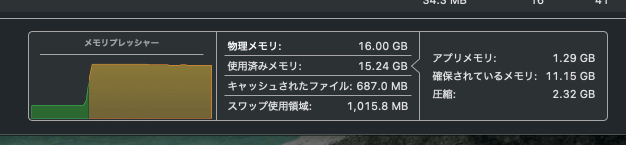

Gemma 4 e4b自体は起動し、文章生成も行えます。ただしメモリはほぼ上限に達しており、別のタスクが走るとスワップが発生してレスポンスが目に見えて遅くなります。並列処理はほぼ期待できません。

単発の文章生成や軽いチャット用途、シンプルなAPI連携であれば使えるレベルです。一方でエージェント系の自動化や複数モデルの切り替え運用は厳しい。

モデルの重さで比べると、Gemma 2 2BやGemma 3 4Bは快適に動きます。Gemma 4 e4bはギリギリ動く、それ以上のモデルは実用外と考えておいたほうが無難です。

16GBは「動かせる最低ライン」であって、余裕のある環境ではありません。

つまり、16GBは「試すには十分、常用するには不足」という立ち位置です。

3. ローカルLLMは「メモリ帯域幅」で体感速度が変わる

LLMのローカル動作では、CPU性能よりもメモリ帯域幅——つまりメモリからデータを読み出す速度——が体感速度に直結します。

モデルの推論中は常に大量のパラメータを読み続けるため、簡単に言うと、この読み込み速度がそのまま「回答の速さ」になります。

実際、M2からM4に乗り換えた場合でもCPU性能の差による体感変化は限定的で、それ以上にメモリ容量やメモリ帯域幅の違いが効いてきます。特にローカルLLMでは、この2つの要素によって「そもそも動くか」「どれだけ快適に使えるか」が大きく変わります。

| チップ | 帯域幅 | 体感 |

|---|---|---|

| M2 | 100GB/s | 標準 |

| M4 | 120GB/s | やや改善 |

| M4 Pro | 273GB/s | 明確に速い |

| M4 Max | 最大546GB/s | 別次元 |

Pro以上になると「返答を待つ感覚」が明確に変わります。

4. AI用途で後悔しないMacの選び方

MacはメモリとSSDの両方を購入時に決める必要があります。後からメモリを増やすことはできません。一方、ストレージは外付けで拡張できます。

よくある失敗は、SSDを1TBに増量してメモリを16GBに抑えるパターンです。ストレージが増えてもAIの動作環境は変わらず、後でメモリ不足に気づいても手の打ちようがありません。

メモリの目安は以下のとおりです。

- 24GB:実用ライン(余裕を持って動かせる最低限)

- 32GB以上:長期運用や複数タスク同時実行を見据えるなら

実際に「ストレージを優先してメモリを削った」構成は、AI用途ではほぼ確実に後悔します。

5. ストレージは外付けSSDで補う

AIモデルは数GB〜数十GBになるため、内蔵SSDはあっという間に圧迫されます。内蔵は最小構成にしておき、モデルデータは外付けNVMe SSDに逃がす運用が合理的です。

Mac miniはポートが限られているため、外付けSSDや周辺機器を増やすと接続まわりで悩みやすくなります。その点、ドック型SSDを使えばストレージ拡張とポート不足を同時に補えるため、デスク環境もすっきりまとまります。

→ Mac miniのポート構成やドッキングステーションの選び方については、実機レビューと比較記事でまとめています。

Mac mini M4 ドッキングステーション実機レビュー|USBポート不足とストレージ問題を同時に解決した話

Mac mini M4 ドッキングステーションおすすめ5選|SSD内蔵モデルを実体験ベースで比較

まとめ

M2 Mac mini(16GB)でもGemma 4は動作しますが、余裕はなく常用には向きません。

「Mac mini 16GBでLLMは使えるのか?」という点では、答えは「動くが余裕はない」です。

| メモリ | 用途感 |

|---|---|

| 16GB | 検証・軽用途向け |

| 24GB | 実用ライン |

| 32GB〜 | 長期・複数タスク向け |

AI用途でMacを選ぶなら、メモリを優先して選び、ストレージは外付けで補うのが長く使える構成です。購入後に後悔しやすいのはメモリの方なので、予算に迷ったらメモリに振ることをおすすめします。